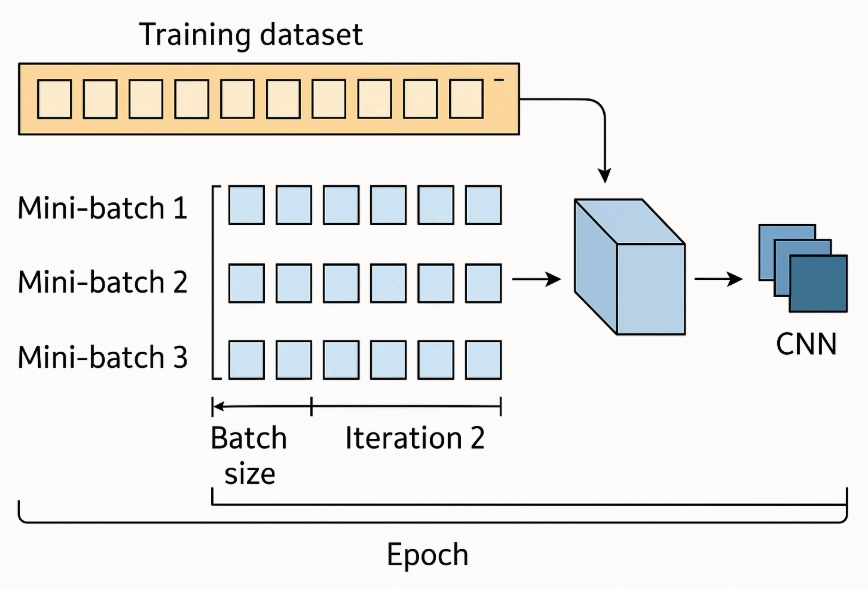

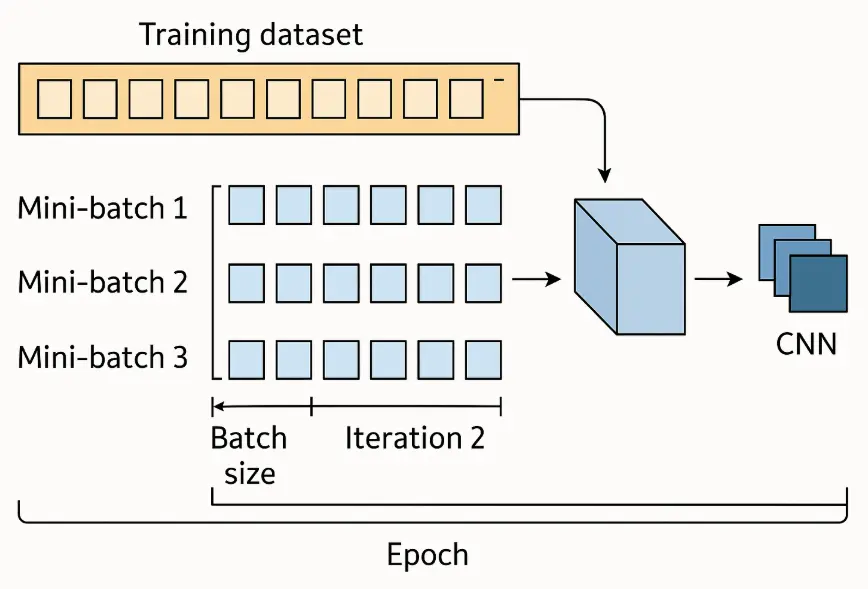

Batch Size

4/2/2026 | 1 minute to read | Tags: 机器学习, 个人心得

Batch Size对模型训练的影响

结论:在同样的模型架构下,

- Batch Size越小,模型性能大概率越好。

- Batch Size越大,模型性能大概率越差。

这是我在做实验的时候偶然发现的。之前一直认为Batch Size对模型性能没有影响,因此Batch Size越大,一次处理的样本越多,训练速度越快,那肯定是Batch Size越大越好。之前电脑上显存有限,一直是batch_size=16这样跑的;后来我在服务器上大批量实验,将batch_size设置为128,效果奇差。排查了半天没找出原因,最后发现是这个问题。

Batch Size的相关问题及如何选择Batch Size的大小 - 知乎

← Back to blog